Hintergrundmaterial zu Praha

Auch wenn die Handlung und die darin vorkommenden Personen und Firmen frei erfunden und vollkommen fiktiv sind – ein Großteil der beschriebenen Technik, viele Institutionen und natürlich die Schauplätze sind es nicht.

Der Autor hat die meisten Städte und Regionen, die in dem Buch beschrieben werden, selber bereist und natürlich auch das eine oder andere der Handlung selbst erlebt. Was davon wird natürlich nicht verraten, aber wer nun mehr über die Hintergründe der Story wissen möchte, dem sind die folgenden Seiten gewidmet. Garantiert keine Fiktion mehr, sondern knallharte Fakten, Quellen und Hintergrundinformationen zum Nachlesen.

Eine unerschöpfliche Quelle von wertvollen Informationen war – wie könnte es anders sein – das Internet, allen voran Google und Wikipedia. Man muss nur die Spreu vom Weizen trennen und die wirklich guten Artikel und Beiträge von der weit größeren Anzahl von richtig schlechtem und fehlerhaftem Material unterscheiden können.

So finden sich in der freien Enzyklopädie Wikipedia unter anderem sehr gute Artikel zu den deutschen, italienischen und europäischen Polizeiorganisationen. Wer sich hier weiter informieren möchte, gibt einfach die Begriffe Carabinieri, Guardia die Finanza, OLAF oder Europol in eine Suchmaschine ein. Die meisten der im Roman vorkommenden staatlichen Institutionen zur Verbrechensbekämpfung gibt es tatsächlich. Manches im Bereich der Staaten-übergreifenden Polizeiarbeit mag noch in den Kinderschuhen stecken oder durch überladene Bürokratie schwerfällig und oft nicht besonders schlagkräftig sein, aber zum Glück gibt es ja Leute wie Claudia und Falk…

Wer sich über den Hafen von Genua und speziell das Terminal Voltri informieren möchte, dem seien deren offiziellen Websites empfohlen. Die Zugangstechnik und deren Manipulation, so wie sie im Roman beschrieben sind, ist natürlich Fiktion. Die halb- oder vollautomatische Steuerung von Portal-Hubwagen und Verladeeinrichtungen im Containerverkehr sind es sicherlich nicht. In vielen Häfen, wie zum Beispiel in Hamburg oder Rotterdam, werden Container bereits heute von Computern gesteuert fast vollautomatisch umgeschlagen. Seit Jahren gibt es in diesem Zusammenhang Systeme wie COREM oder die im Roman beschriebenen ISO-Normen für die BIC-Codes zur weltweit eindeutigen Identifizierung von Containern.

Der größte und für den Leser wohl interessanteste Aspekt des Romans ist vermutlich, was von den beschriebenen Angriffstechniken im Bereich der Computer und deren weltweiter Vernetzung tatsächlich heute schon machbar und was mit entsprechendem Aufwand zukünftig tatsächlich denkbar ist.

Kernpunkt der massiven Bedrohung durch die Trojaner und Schadsoftware im Roman ist, dass diese nicht mehr auf dem derzeit üblichen Weg in Form von Software durch Herunterladen von dubiosen Internetseiten, verseuchten E-Mail-Anhängen im Laufe der Nutzung eines Computers auf diesen gelangen, sondern bereits beim Kauf in Form von Hardware vorhanden sind. Dies stellt nach Expertenmeinung die größte Gefahr für den Nutzer dar, da die Schadsoftware vor dem Virenscanner aktiv wird und sich daher tarnen kann. Das versuchen auch konventionelle Viren. Gelingt es dem Virenprogrammierer, seinen Virus zunächst unerkannt auf den zu infizierenden PC zu installieren, zum Beispiel weil der Virenscanner diesen Virus noch nicht kennt, so hat dieser einen entscheidenden Vorteil. Er kann ab sofort den Virenscanner so manipulieren, dass er nur noch vordergründig aktiv ist, letztlich aber nicht mehr auf die Jagd geht. Dem Benutzer wird nur vorgegaukelt, dass der Scanner fehlerfrei arbeitet.

Solange die übliche Installations-Reihenfolge eingehalten wird, greift dieses Verfahren nur in den seltensten Fällen. In der Regel wird ein (neuer) PC formatiert und enthält keinerlei Programme und Daten (und auch keine Viren). Dann wird ein Betriebssystem installiert und einer der ersten Schritte eines guten Systembetreuers oder Lieferanten ist, einen aktuellen Virenschutz aufzuspielen. Erst dann werden Programme und Daten aus möglichst zuverlässiger Quelle hinzugefügt. Gerät nun ein Schädling in das System, so schlägt ein Virenscanner in der Regel sofort Alarm und verhindert die weitere Ausbreitung und das Einnisten der sogenannten Malware.

Password

Die große Gefahr sind somit also Viren, die vor dem Betriebssystem und dem Virenscanner in den Arbeitsspeicher gelangen können und die Kontrolle über die CPU übernehmen, bevor die Schutzmechanismen geladen werden. Ansatzweise geschieht dies seit einiger Zeit durch so genannte Root-Kits, die sich in die Boot-Sektoren der Festplatten einnisten und damit vor dem eigentlichen Betriebssystem geladen werden und bestimmte Aktionen zu ihren Gunsten „verbiegen" können. Sehr umstritten ist dies bereits in Form von Kopierschutzmechanismen, die sich ungefragt in diesen Sektor installieren und das illegale Kopieren von Copyright-geschützten Daten verhindern sollen.

Letztlich können diese Root-Kits jedoch aufgespürt werden, wenn das System nicht von der betreffenden Festplatte gestartet wird, sondern von einer sauberen Boot-Disk (zum Beispiel Antiviren-Notfall-CD). Dann ist der Virenschutz wieder zuerst im Speicher.

Absolut fatal wäre es, wenn der Virus tatsächlich aber in der Hardware des Rechners, also auf dem Mainboard sitzen würde und nicht auf einem Speichermedium, wie einer Festplatte. Wäre er beispielsweise im sogenannten BIOS implementiert, so hätte er prinzipiell die Kontrolle über den gesamten Computer. Im BIOS sind nämlich, wie der Name Basic Input Output System schon sagt, Routinen für das Starten des Systems hinterlegt - ein rudimentäres System, welches den PC überhaupt erst beim Einschalten zum Leben erweckt. Hier ist beispielsweise gespeichert, wo der Rechner das Betriebssystem findet, um es dann anschließend zu booten. Viele grundlegende Operationen laufen zur Startzeit, aber auch nachdem der Rechner regulär gebootet wurde über dieses BIOS (Man denke nur an DHCP-Requests o.ä. der internen Netzwerkkarte für einen Netzwerk-Bootvorgang etc.). Das BIOS ist in der Regel eng mit dem sogenannten Chipsatz des Mainboards verwoben und stellt eine Schnittstelle zwischen RAM, CPU und Peripheriegeräten dar. Ein Virus, der hier angreifen würde, hätte verheerende Möglichkeiten, dem System und dem Nutzer zu schaden.

Die Existenz solcher BIOS Viren wird immer wieder auch in Fachkreisen diskutiert. Nach Kenntnisstand des Autors sind bisher jedoch keine solcher BIOS-Viren grundsätzlich oder gar in größerer Menge gefunden worden. Das liegt daran, dass deren Programmierung und Implementierung einen erheblichen Aufwand verursachen würde, tatsächlich ähnlich dem, wie er im Roman beschrieben ist. Neben der Änderung des Chip-Designs, was nur wenige Spezialisten beherrschen (nicht aber die üblichen Viren-Programmierer) wäre auch die komplette Produktionskette betroffen. So etwas lässt sich Gott sei dank auch mit viel Geld nicht so einfach realisieren, wie im Buch erzählt. Vor allem der Einbau eines zusätzlichen Layers in dem Chip bei ansonsten gleichen elektrischen Eigenschaften und Funktionen, entspricht natürlich der Phantasie des Autors. Was natürlich nicht heißt, dass dies nicht doch einmal geschehen oder funktionieren könnte. Gerade Bemühungen von Herstellern und staatlichen Institutionen, Computer mit zusätzlichen Funktionen zur eindeutigen Identifizierung (zum Beispiel im Internet) Hardware-seitig auszustatten, dürfen in diesem Kontext durchaus kontrovers und kritisch betrachtet werden. Forderungen und Gesetzesinitiativen zur Online-Durchsuchung von Computer-Systemen im Rahmen der Rasterfahndung und sogar dem Verbot, sich dagegen zu wehren, sind klare Absagen zu erteilen und sie sind mit aller Macht zu verhindern.

Nachfolgend gibt der Autor nun als Auszug aus seinem Fachaufsatz zum Thema Datenschutz und Datensicherheit einen Einblick in die verschiedenen Begrifflichkeiten rund um dieses Thema.

Digitale Signatur und Verschlüsselung

Im Geschäfts- wie im Privatleben hat sich das Medium „E-Mail" als leistungsfähiges und effektives Kommunikationsmittel etabliert. So werden hierüber Informationen, Dateien und Nachrichten ausgetauscht, Verabredungen getroffen, Aufträge erteilt und Verträge geschlossen.

Was vielen Nutzern dabei nicht bewusst ist, ist, dass dieser E-Mail-Verkehr nicht nur mitgelesen (abgehört) werden kann, sondern auch, dass Teile der E-Mail oder die E-Mail komplett gefälscht werden können. Zudem muss der tatsächliche Absender nicht derjenige sein, der in der E-Mail als vermeintlicher Versender hinterlegt ist.

Hieraus resultieren ernsthafte wirtschaftlich und rechtlich relevante Konsequenzen. Aufgrund der Tatsache, dass der komplette E-Mail-Verkehr gefälscht werden kann, gilt dieser vor Gericht grundsätzlich nicht als Beweis. Möchte eine Streitpartei also beweisen, dass die gegnerische Seite eine bestimmte Aussage getätigt hat, so kann hierzu keinesfalls eine entsprechende E-Mail als anerkannter Nachweis herangezogen werden. Selbst das übliche Zitieren der Originalnachricht bei einer Antwort (Reply) dient zwar in der Praxis als gern genutztes Feature, um den Gesprächsverlauf auch im Nachhinein nachvollziehen zu können, jedoch ist auch eine solche E-Mail-Kette (Thread) manipulierbar und damit als Beweis wertlos.

Die rechtliche Anerkennung einer E-Mail scheitert also an zwei Punkten: Erstens ist der Inhalt einer E-Mail teilweise oder komplett fälschbar und zweitens ist der Absender der E-Mail nicht zweifelsfrei zu identifizieren beziehungsweise einer natürlichen Person zuzuordnen.

Ärgernis SPAM

Es ist sehr einfach, an eine anonymisierte E-Mail-Adresse zu gelangen. Hierzu gibt es genügend Internet-Dienste, die - rein auf Werbebasis finanziert - Privatleuten einen kostenlosen E-Mail-Account anbieten. Die Legitimationsprüfungen bei Anlage einer solchen E-Mail-Adresse sind auf einfache Weise zu umgehen. Hierdurch kann der Nutzer dieser E-Mail-Adresse sich vollkommen anonym im Medium Internet bewegen. Es müssten nun mit dem Account schon sehr schwerwiegende Rechtsverstöße begangen werden, damit dieser erhebliche Aufwand betrieben würde, anhand der in den E-Mails hinterlegten Routen-Informationen über die beteiligten Internet-Provider den Weg bis hin zum Absender-PC zurück zu verfolgen. Da hierzu auch anonym ein Internet-Café-Rechner benutzt worden sein könnte, wird die Zuordnung zu einer bestimmten Person schwierig bis unmöglich sein.

Professionelle Spammer nutzen zum Versenden ihrer Werbe-E-Mails sogar illegal und oft unbemerkt fremde Rechner und verwischen ihre Spuren in der Regel so gut, dass der Ursprung einer solchen Werbe-E-Mail nicht zurückverfolgt werden kann.

Der Feind hört mit

Aber selbst, wenn ein Benutzer einen regulären E-Mail-Account nutzt und sich in seiner elektronischen Nachricht durch Angabe von Name und Postadresse zu erkennen gibt, ist er selber nicht sicher davor, dass seine E-Mail auf dem Weg zum Empfänger nicht verfälscht oder mitgelesen werden kann. E-Mails werden standardmäßig vollkommen unverschlüsselt im Klartext verschickt und liegen für kurze Zeit immer wieder auf den am Transport der Nachricht beteiligten Systemen der einzelnen Internet-Dienstleister. Durch gezieltes Abhören des Datenstroms oder unerlaubte Zugriffe auf die Postfächer mit den dort als Datei gelagerten E-Mails ist es also möglich, den Inhalt mitzulesen und, eine geeignete Infrastruktur oder Zugriffsrechte vorausgesetzt, diese auch zu verändern (oder die Zustellung ganz zu unterbinden).

Um diese Probleme nun zuverlässig zu beheben, bedarf es zweier Mechanismen: Erstens müssen E-Mails so gekennzeichnet werden, dass bereits die kleinste nachträgliche Manipulation angezeigt werden kann und zweitens müssen die E-Mails so verschlüsselt werden, dass nur der legitimierte Empfänger diese wiederum entschlüsseln kann.

Die digitale Unterschrift

Das Anzeigen einer Datenmanipulation kann man dadurch erreichen, dass man eine elektronische Nachricht oder auch eine Datei digital signiert. Hierbei wird aus den Daten der Originalnachricht zusammen mit einem speziellen Schlüssel eine Prüfsumme gebildet (Hash-Wert) und mit der E-Mail oder Datei abgespeichert. Wird nun die Nachricht nachträglich verändert, so passt der beim Empfang der E-Mail ebenfalls errechnete Hash-Wert nicht mehr mit der übermittelten Prüfsumme überein. Somit ist das Siegel „zerbrochen" und die Nachricht wird entsprechend als kompromittiert gekennzeichnet.

Nun hat der deutsche Gesetzgeber im Jahre 2002 das so genannte Signaturgesetz verabschiedet, in dem die digitale Signatur der natürlichen Unterschrift bis auf bestimmte Ausnahmefälle (zum Beispiel Grundstückskauf) rechtlich gleichgestellt wird. Auch wenn der technischen Umsetzung dieses Gesetzes in der Praxis bisher nicht die Bedeutung beigemessen worden ist, wie vielleicht gewünscht oder erwartet, so gibt es zwischenzeitlich jedoch Lösungen, um elektronisch zu signieren.

Man unterscheidet hierbei grundsätzlich zwei Formen der Signatur: eine un- oder nicht qualifizierte Signatur und eine qualifizierte Signatur jeweils mit zwei Unterformen. Eine nicht-qualifizierte Signatur genügt nur niedrigen Sicherheitsanforderungen bezüglich der Herausgabe und der Überwachung eines Zertifikates und ist daher für die meisten rechtlich relevanten Geschäftsprozesse vollkommen uninteressant. Der konzeptionell schwache Schutz einer unqualifizierten elektronischen Signatur schlägt sich in der Praxis durch die geringe Akzeptanz und die eingeschränkte Verwendbarkeit bei wirklich interessanten Transaktionen nieder. Darüber kann dann auch nicht das vergleichsweise einfache Verfahren zum Erwerb einer solchen Signatur hinwegtrösten (das ist ja gerade das Problem). Zum Erhalt einer qualifizierten Signatur bedarf es daher eines deutlich höheren administrativen Aufwand zur Prüfung der Legitimation des Beantragens eines Zertifikates und dies ist auch mit entsprechenden Kosten verbunden.

Ohne Zertifikatsgeber keine Verifikation

Grundsätzlich müssen sich alle Zertifikatsgeber (Trust-Center) bei der Regulierungsbehörde für Telekommunikation und Post (kurz RegTP) zertifizierten lassen. Über die RegTP erhält man daher auch eine aktuelle Liste der registrierten Zertifikatsgeber, ohne dass diese eine besondere Empfehlung für den einen oder anderen Anbieter ausspricht. Hat man sich für einen Anbieter entschieden, so beantragt man als natürliche Person oder Institution eine qualifizierte Signatur auf dem Schriftweg. Da im Falle einer natürlichen Person die elektronische Signatur eindeutig zugeordnet werden soll, muss der Herausgabe eine persönliche Identitätsprüfung vorausgehen. Dies erfolgt, je nach Anbieter, durch das persönliche Abholen der Signaturkarte und Legitimation per Ausweisdokument an zentralen Stellen (zum Beispiel teilnehmende IHK's) oder zum Beispiel per Post-Ident-Verfahren, bei dem der Antragsteller sich gegenüber einem Mitarbeiter der Deutschen Post am Schalter legitimiert. Somit soll sichergestellt werden, dass man nicht anonym in den Besitz einer qualifizierten Signatur gelangen kann.

Technische Realisation

Technisch wird das Signieren dann so gelöst, dass an den PC ein Kartenlesegerät angeschlossen wird, in das die Signaturkarte eingesteckt wird. Dann werden einmalig entsprechende Treiber und Anwendungsprogramme bzw. Plug-In's installiert, mit deren Hilfe man das auf der Karte enthaltene Zertifikat nutzen kann. Beim Versenden von Nachrichten zum Beispiel mit Outlook kann dann als Option die Nachricht mit diesem Zertifikat signiert werden. Der Empfänger erkennt eine signierte Nachricht an einem speziellen Symbol, welches nach Anklicken entsprechende Informationen über die Signatur preisgibt. So lässt sich erkennen, ob die Signatur gültig und die Nachricht unverfälscht eingetroffen ist. Wurde auf dem Weg vom Sender zum Empfänger auch nur ein einziges Byte verändert, so ist die Signatur ähnlich wie bei einem klassischen Siegel zerbrochen. In der Praxis hat das Signieren von E-Mails einen gewissen Handling-Nachteil. So muss der Versender i.d.R. bei jedem Abschicken einer Nachricht eine PIN am Kartenterminal zur Freigabe eingeben und beim Empfänger muss das Zertifikat des verwendeten Trustcenters installiert sein. Sofern sich das Trust-Center nicht bei den betreffenden Herstellern bereits authentifiziert hat (zum Beispiel bei Microsoft), „kennt" das Empfängersystem das Zertifikat der eingehenden E-Mail nicht und es muss daher manuell installiert werden. Erst danach ist eine Online-Überprüfung automatisiert möglich, die es dem Empfänger erlaubt, die Gültigkeit der verwendeten Signatur zu überprüfen. Es liegt in der Natur der Sache, dass primär der Empfänger signierter Nachrichten einen Vorteil erhält (nämlich, dass er sich sicher sein kann, dass die empfangene E-Mail tatsächlich von dem angegebenen Sender stammt und diese nicht verfälscht wurde), der Sender jedoch den Aufwand und die Kosten trägt. Dies ist sicherlich ein Grund, warum die digitale Signatur bisher keine massenhafte Verbreitung erfahren hat. Es ist jedoch erstrebenswert, dass es sich zumindest im geschäftlichen Umfeld einbürgert, Nachrichten zu signieren, um neben der gewünschten Rechtssicherheit auch das Problem SPAM zu lösen.

Verschlüsselung

Das digitale Signieren löst aber nur das eine der beiden Probleme, nämlich das Erkennen, ob eine Nachricht unverfälscht oder manipuliert empfangen wurde. Auch eine digital signierte E-Mail ist weiterhin im Klartext für jedermann lesbar. Dieses Problem löst somit erst das Verschlüsseln (Chiffrieren) der Nachrichten.

Symmetrische Verschlüsselung

Ein einfaches Verfahren, um Nachrichten zu verschlüsseln, kennen viele sicherlich noch aus der Kindheit. Hier hat man die Buchstaben einfach um eine bestimmte Anzahl von Stellen nach hinten im Alphabet verschoben. Bei einem Versatz zum Beispiel um drei Zeichen wird aus einem A ein D, aus einem B ein E und so weiter. Der Empfänger der Nachricht muss hierbei also nur wissen, um wie viele Stellen er die Zeichen wieder nach vorn im Alphabet verschieben muss, um die Information im Klartext lesen zu können. Den Informationsaustausch über die Anzahl der Stellen (Schlüssel) bezeichnet man als Schlüsselaustausch. Das klassische Verfahren nutzt dabei den gleichen Schlüssel für Ver- und Entschlüsselung. Man bezeichnet dies daher als symmetrisches Verfahren. Zur Entschlüsselung muss der Empfänger also stets den gleichen Schlüssel besitzen, der zuvor über ein sicheres Medium (zum Beispiel Kurier) ausgetauscht wurde. Keinesfalls darf der geheime Schlüssel nun über das gleiche, unsichere Medium übertragen werden, wie die Nachricht selbst, da sonst ein Lauscher die verschlüsselte Nachricht problemlos entschlüsseln könnte.

Asymmetrische Verschlüsselung

In der Praxis haben sich daher in der neueren Geschichte so genannte asymmetrische Verfahren zur Verschlüsselung bewährt. Hierbei existiert jeweils ein Schlüsselpaar, bestehend aus einem privaten, geheimen und einem öffentlichen Schlüssel (Private und Public Key). Das Verfahren, welches auf Diffie-Hellman zurückgeführt wird, funktioniert dabei wie folgt:

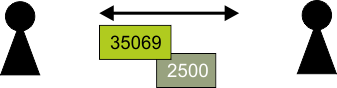

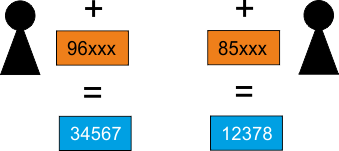

Beide Kommunikationspartner einigen sich auf zwei Zahlen, ein große Primzahl sowie eine ganze Zahl, die kleiner als die Primzahl sein muss. Der Austausch dieser beiden Zahlen kann öffentlich erfolgen und hat keinen Einfluss auf die Sicherheit. Dann generiert jeder eine weitere, geheime Zahl (Private Key). Dann wird eine Berechnung mit dem Private Key und den vorher ausgetauschten beiden Zahlen durchgeführt, welches im Ergebnis den Public Key darstellt.

Nach gegenseitigem Austausch der beiden Public Keys führen sie jeweils eine private Berechnung für den eigenen Private Key und den Public Key des Kommunikationspartners durch. Die Zahl, die sich daraus ergibt, ist der Session-Key (ist für beide Partner gleich). Der Session-Key kann nun als geheimer Schlüssel für einen anderen Verschlüsselungsalgorithmus wie zum Beispiel DES genutzt werden. Ohne Kenntnis eines der beiden Private Keys kann nun kein Dritter zum gleichen Session-Key und damit zum Schlüssel zum Dechiffrieren der Nachricht gelangen.

Der große Vorteil des Verfahrens ist, dass ein Beobachter auch in Kenntnis beider öffentlicher Schlüssel die Nachrichten nicht dechiffrieren kann. Die verwendeten mathematischen Verfahren lassen sich sehr leicht vorwärts, aber nur sehr schwer rückwärts rechnen. Man bezeichnet so etwas auch als „Falltür-Algorithmus" der nur in eine Richtung funktioniert. Vergleichbar ist das mit auch mit einem Fleischwolf: Wenn Sie ein Schwein durch einen Fleischwolf drücken, kommt Hackfleisch heraus. Drücken Sie das Hackfleisch nun wieder zurück durch den Fleischwolf, werden Sie oben kein Schwein heraus bekommen.

Virtual Private Networks (VPN)

Anwendung findet eine solche Verschlüsselung zum Beispiel in sogenannten VPN's, bei denen mit Hilfe der Kryptografie die zu transportierenden Daten an den Kopfstellen der Kommunikationspartner so verschlüsselt werden, dass für den Datentransport ein unsicheres, offenes Medium wie zum Beispiel das Internet genutzt werden kann und die Daten auf ihrem Weg nicht oder nur erschwert durch Dritte mitgelesen werden können.

Brute-Force-Attacken

Selbstverständlich sind prinzipiell alle Verschlüsselungsverfahren spätestens durch so genannte Brute-Force-Attacken (mit „brutaler Gewalt") zu knacken, jedoch bedarf es bei modernen Verfahren und entsprechend großen Verschlüssellungstiefen (zum Beispiel > 128 BIT) sehr viel Rechenzeit, so dass solche Attacken allein in der Praxis nicht immer in einem realistischen Zeitrahmen durchführbar sind.

Passwort-Sicherheit

Erst durch gezieltes Ausnutzen von konzeptionellen oder von Benutzern verursachten Schwachstellen wird eine Brute-Force-Attacke zum Ziel führen. Ein Beispiel dafür ist zum Beispiel das Knacken von Windows Passwörtern. Vor allem ältere Windows-basierende Clients speichern Benutzerpasswörter in einem sehr unsicheren LANMAN-Hash-Format. Solche Passwörter werden wie bei UNIX auch nie im Klartext auf einem Server gespeichert, sondern im sogenannten HASH-Format. Windows Passwörter können max. 14 Zeichen lang sein und werden in zwei Teilen á 7 Zeichen gespeichert. Kürzere Passwörter werden vom System aufgefüllt. Da der Zeichenvorrat relativ begrenzt ist, bei den alten Windows-Versionen grundsätzlich nicht zwischen Groß- und Kleinschreibung unterschieden wird und die Benutzer sehr oft triviale Passwörter wählen, ist eine Brute-Force-Attacke, wenn Sie mit Zugriff auf die Passwortdatenbank erfolgen kann, in der Praxis mit Programmen für rund 40,- € eine Frage von wenigen Minuten.

Oft werden nämlich Teile des Passwortes mit einer Wörterbuch-Attacke dechiffriert, so dass man sich nachfolgend mit einer Brute-Force-Attacke nur noch auf wenige Zeichen beschränken muss oder Reststücke erraten werden können. Als Abhilfe ist es daher ratsam, bei Windows 2000 oder XP-Systeme den LANMAN-Hash über die Registry zu deaktivieren (wodurch sich allerdings keine Windows 98 Maschinen mehr anmelden können).

Bei der Passwort-Wahl sollte man darauf achten, dass die Passwörter aus Buchstaben, Zahlen und Sonderzeichen zusammengesetzt werden, möglichst lang sind und natürlich nur an äußerst sicheren Stellen hinterlegt werden dürfen (nicht mit einem Zettel am Bildschirm oder unter der Tastatur). Eine gute Hilfestellung zum Merken von Passwörter ist es, die Anfangsbuchstaben der Wörter eines Liedtextes (incl. Satzzeichen) zu verwenden: „Hoch auf dem gelben Wagen – sitz ich beim Schwager vorn." ergibt als Passwort zum Beispiel „HadgW,sibSv." oder „Ein Jäger aus Kurpfalz" ergibt „1JaeauKu" und so weiter.

Angriffe von innen – Social Engineering

Die Bedrohungs-Szenarien Datenausspähung, -manipulation und -zerstörung entspringen hierbei nicht immer dem „bösen" Internet, sondern haben ihre Quelle oder die undichte Stelle oft auch im eigenen Netz (Social Engineering). Ein unzufriedener oder vor der Entlassung stehender Mitarbeiter hat schon oft Daten zerstört oder zur späteren (missbräuchlichen) Nutzung entwendet.

Angriffe von außen

Die Bedrohungs-Szenarien, die von außen an ein EDV-System herangetragen werden, sind sicherlich vielfältiger und weit verbreiteter. Gilt ein IT-System ohne Kommunikationsschnittstellen nach außen (Online, Datenträgeraustausch etc.) per se als sicher (wenn man den lokalen Zutritt zum System aus der Betrachtung herausnimmt), so ändert sich das Bedrohungspotential bei einer Online-Anbindung nach außen deutlich.

Würmer und Trojaner

In der Praxis gibt es dabei i.d.R. weniger direkte und gezielte Hack-Angriffe von außen auf ein EDV-System, sondern vielfach eine über Würmer und Trojaner ausgelöste meist unkontrollierte Versendung von vertraulichen Daten von innen nach außen. Sicherlich stehen bestimmte Firmen und Institutionen ganz oben auf der Wunschliste von Hackern und Spionen (zum Beispiel Firmen wie Microsoft, Rüstungsunternehmen oder Einrichtungen der öffentlichen Hand), in der Vielzahl der Fälle sammeln Hacker jedoch Informationen in der Breite der Masse über Trojaner, um sie dann gezielt nach verwertbarem Material zu durchforsten.

Direkte Angriffe

So ist der einzelne Rechner oder ein Firmennetzwerk oft aus dem Internet gar nicht ohne Kenntnisse bestimmter, ständig wechselnder Informationen zu identifizieren, so dass eine gezielte Attacke hier nur mit erhöhtem Aufwand und Insider-Kenntnissen realisierbar ist. Bei der Einwahl ins Internet erhält man von den meisten Providern i.d.R. ständig wechselnde TCP/IP-Adressen, über die das Netzwerk dann erreichbar ist. Ohne Kenntnis der aktuellen IP-Adresse ist somit der gezielte Angriff auf ein Netz nicht möglich. Daher versucht man durch entsprechend verseuchte E-Mails oder Webseiten so genannte Würmer und Trojaner in die Systeme einzuschleusen, die dann, einmal im Wirts-System eingenistet, von sich aus für die Verbreitung von sensitiven Daten an vorher festgelegte Ziele sorgen. So versucht man beispielsweise mit einem Key-Logging sämtliche Tastenanschläge des Benutzers mitzulesen, um auf diese Art und Weise zum Beispiel Passwörter für andere Systeme, wie Online Banking u.a., mitzuschreiben.

Phishing

Eine andere, mittlerweile sehr verbreitete Form der Datenausspähung ist das so genannte „Phishing". Dieses Kunstwort beschreibt das „Passwort Fishing", d.h. das Fischen nach Passwörtern beispielsweise im E-Mail- und Online-Verkehr durch Umleiten von Benutzereingaben auf entsprechend präparierte Web-Seiten. Hierbei wird zum Beispiel eine offiziell aussehende E-Mail mit Logo und Layout der entsprechenden Unternehmen, wie zum Beispiel Microsoft, Ebay oder Bankinstituten, per SPAM-Verfahren massenhaft an verschiedenste Empfänger verschickt und diese darin aufgefordert, sich bei dem entsprechenden Dienst anzumelden, um zum Beispiel die Vertragsdaten zu aktualisieren. Wer zum Beispiel öfters über Ebay einkauft, wird sich möglicherweise nichts dabei denken, wenn er eine „gut" gemachte Nachricht erhält, in der er aufgefordert wird, sein Passwort aus Sicherheitsgründen zu ändern. Der nachfolgende Einlog-Vorgang, der dann über die in der E-Mail enthaltenen Hyperlinks erfolgt, landet dann jedoch nicht bei dem richtigen Online-System Ebay, sondern wird von einem Hacker-System abgefangen.

Man-in-the-middle-Attacken

Die „Perfektion" solcher Angriffe sind dann die „Man-in-the-middle-Attacken", bei denen sich der Angreifer in die Kommunikation zwischen Anwender und Anbieter schaltet und die Eingaben und Ausgaben der Systeme manipuliert. Gelangt solch ein Angreifer beispielsweise in die Kommunikation mit dem Bank-Institut beim Online-Zahlungsverkehr, so ist es dem Angreifer möglich, die Eingaben des Benutzers mitzuschreiben und zum Beispiel für Kontostandabfragen an die Bank weiterzuleiten und das Ergebnis dem Nutzer auch 1:1 weiterzureichen, um ihn in Sicherheit zu wiegen. Bei einer nachfolgenden Transaktion (Online-Überweisung) jedoch leitet er die Eingaben nicht an die Bank weiter, sondern simuliert die Antworten der Bank lediglich. Nachfolgend überweist er dann mit Hilfe der mitgeschriebenen Passwörter und TAN-Nummern einen Geldbetrag auf ein von ihm kontrolliertes Konto. Der Nachweis einer solchen Manipulation ist dann nicht einfach und der Anwender wird möglicherweise beweispflichtig.

Anmerkung: Die im Roman beschriebene Angriffstechnik der Trojaner entspricht prinzipiell einer solchen Man-in-the-middle-Attacke, nur dass der Angreifer sich nicht in der Mitte der Kommunikation befindet, sondern auf dem PC des Anwenders. Hierdurch kann er die Daten für seine Zwecke manipulierten, bevor sie auf dem System des Absenders signiert und verschlüsselt werden.

Laut Informationen des Branchenverbandes Bitkom haben im Jahr 2006 im Raum der BRD Betrüger in mehr als 3250 Fällen rund 13 Millionen Euro von den Konten ihrer Opfer abgehoben. Der durchschnittliche Schaden lag damit bei rund 4000,- €. Die Anti-Phishing-Arbeitsgruppe APWG registrierte im Zeitraum von Mai 2006 bis Mai 2007 monatlich zwischen 20.000 und 29.000 Attacken. Weltweit werden nach Stand von 2007 rund 37.000 gefälschte Bank-Webseiten betrieben, die meisten davon in den USA. Die im Roman von Nupaky & Co veranschlagte Schadenssumme von 10.000 € x 100 Millionen Attacken ist damit gar nicht so weit hergeholt.

Sichere Kommunikation

Um dies zu vermeiden, bedient man sich daher sinnvollerweise gerade bei kritischen Übertragungen entsprechender gesicherter Verfahren wie beispielsweise der SSL-Kommunikation oder Online-Banking-Standards wie zum Beispiel dem HBCI Verfahren. Manipulationen sind zwar auch hier nicht ausgeschlossen, jedoch deutlich schwieriger zu bewerkstelligen als bei ungesicherten Verfahren. So bringen solche Verfahren in Kombination mit speziellen Online-Banking-Programmen, wie zum Beispiel Starmoney, Sfirm und so weiter Sicherheitsvorteile, da hier eine von den Programmen gesteuerte und überwachte Übertragung stattfinden und keine unsichere Kommunikation über Web-Browser durch den Benutzer initiiert wird.

Fernwartung

Besonderes Augenmerk gilt es Fernwartungszugängen zu schenken. Mittels Fernwartungszugängen werden für externe Benutzer oder IT-Dienstleister Zugänge zum EDV-System geschaffen, mit denen diese i.d.R. einen Vollzugriff auf das interne System erhalten. Mit Programmen wie zum Beispiel VNC, PC-Anywhere oder dem in neueren Windows-Versionen enthaltenen Remote-Desktop ist es möglich, ein anderes System so zu steuern, als ob man direkt davor sitzt. Was im Problem- und Fehlerfall ein Segen sein kann und schnelle Hilfe ermöglicht, kann im Missbrauchfall katastrophal sein. Ein gehackter Fernzugang kann so zum Beispiel in der Nacht bei laufendem Netzwerkserver als ausgiebig nutzbare „Spielwiese" für einen Hacker dienen. Aus diesem Grund sollte der Fernzugang entsprechend gesichert sein, Passwörter öfters gewechselt werden und der Personenkreis für den Zugriff auf das absolut notwendige und vertretbare Maß reduziert sein. U.U. sind hier auch rechtliche oder standesrechtliche Vorgaben zu berücksichtigen, wie beispielsweise die Empfehlung der Bundesärztekammer, Fernzugriff auf Patientendaten grundsätzlich zu verbieten oder nur mit Aufsicht durch den Arzt zuzulassen.

Wireless LAN

Eine Schwachstelle beim Ausspähen von Daten sind die in den letzten Jahren in Mode gekommenen WLAN's, Funknetze also, die häufig auch in sensiblen bereichen wie Arztpraxen zu finden sind. Da die Funknetze Bestandteile des eigentlichen Netzwerkes sind und somit eine Verbindung zu den zu schützenden Patientendaten besitzen, andererseits aber aufgrund der physikalischen Eigenschaften der Funkwellen weit über die Praxisräume hinaus abhörbar sind, gilt es gerade hier, besonderes Augenmerk auf Verschlüsselung und Absicherung zu werfen. Man schätzt, dass noch rund die Hälfte der WLAN's in Deutschland vollkommen offen betrieben werden, begründet durch die standardmäßige Deaktivierung aller Sicherheitsmaßnahmen und die Unwissenheit der Betreiber, die die Geräte oft in Eigenregie „out of the box" installieren und sich über die „gelungene" Standardinstallation freuen. So genannte „War Chalkings" an den Hauswänden zeigen dann von „War Drivern" gefundene, offene Netzwerke an.

Intrusion Detection

Da kein System der Welt als 100% sicher vor Einbrüchen und Manipulationen angesehen werden kann und faktisch jede noch so ausgeklügelte Sicherheitsbarriere mit entsprechendem Aufwand umgangen werden kann, kommt der Feststellung, dass es einen konkreten Angriff auf die EDV gibt oder gab und nachfolgend der entsprechenden Beweissicherung, immer mehr Bedeutung zu. Gerade für Unternehmen, die für Angreifer ein lukratives Ziel darstellen bzw. deren EDV für das tägliche Geschäft als Herzstück oder Rückgrat zu bezeichnen ist, ist es äußerst empfehlenswert, sich frühzeitig vor einer Bedrohung Gedanken über Alarmierungssysteme (Intrusion Detection) und konkrete Ablaufpläne im Schadensfall zu machen (Incident Response).

Bei einem tatsächlichen Vorfall kollidieren fast immer zwei gegensätzliche Interessen. Auf der einen Seite wird man bemüht sein, ein zum Beispiel mit einem Virus oder Trojaner befallenes System schnellstens wieder im Produktiveinsatz nutzen zu können. Andererseits ist bei einem entstandenen Schaden oder dem Verdacht auf systematische und strafbare Handlungen die konzeptionell richtig angelegte Beweissicherung elementar wichtig, jedoch auch sehr aufwändig. Ein kleiner Fehler, wie allein das bloße Herunterfahren des kompromittierten Systems, machen es dem Analytiker u.U. schon unmöglich, wichtige Beweise zu sichten und zu sichern, die in einem möglichen späteren Gerichtsverfahren entscheidend für dessen Ausgang sein werden.

Incident Response

Es gibt also ein paar Grundregeln, die beachtet werden müssen, wenn der Fall der Fälle eintritt und der Verdacht oder konkrete Hinweise bestehen, dass ein Computer oder ein Netzwerk von Fremden angegriffen („gehackt") wird oder wurde bzw. wenn aus anderen Gründen eine analytisch wie rechtlich sichere Untersuchung an der EDV-Anlage vorgenommen werden soll. Im Idealfall erstellt ein Unternehmen vor einem konkreten Fall einen allgemeinen Notfall- und Alarmierungsplan, der den zuständigen Mitarbeitern zugänglich gemacht wird. Man bezeichnet die (strukturierte) Reaktion bei einem Verdachtsfall als „Incident Response". Elementar für die nachfolgende Beweissicherung und Analyse der Erkenntnisse ist, dass an dem betroffenen System keine Veränderungen vorgenommen werden und der Zugang zu diesem auf das absolute Minimum an Personen begrenzt wird (Authentizität des Beweises). Sämtliche Schritte, die ab der Alarmierung durchgeführt werden, sind lückenlos zu dokumentieren. Frühzeitig wird hierbei auch eine Unterscheidung stattfinden, ob es sich tatsächlich um eine missbräuchliche Nutzung eines EDV-Systems oder nur um eine „normale" Betriebsstörung handelt.

Regeln für den Fall der Fälle

Der Tod vieler Beweise sind in der frühen Phase übereifrige Anwender und Administratoren, die zum Beispiel auf erkannte Fehlfunktionen (Dialer-, Viren oder Trojaner-Befall) oder Hackerangriffe durch Herunterfahren des Systems oder gar durch Löschen von verdächtigen Programmen und Registrierungsinformationen reagieren. Hierdurch werden fast immer wichtige Beweise zerstört bzw. die nachfolgende Analyse, was genau auf dem Computer-System manipuliert wurde, erschwert. Der aktuelle Speicherinhalt des Rechners ermöglicht u.U. sehr aufschlussreiche Analysen bezüglich der aktiven Prozesse und Spuren, die bei der letzten Aktion hinterlassen wurden. Durch das Herunterfahren eines Systems jedoch werden die Inhalte des flüchtigen Speichers (RAM) und temporär angelegte Dateien gelöscht und der Inhalt und Status unzähliger Systemdateien verändert. Das erneute Hochfahren eines Rechners wiederum verstärkt diese Manipulationen nochmals erheblich. Bei einem Windows- oder Linux-System mit entsprechendem Desktop werden in der Startphase rund 1000 Dateien „angefasst" und so unter anderem die Dateiattribute „Letzter Zugriff" oder „Letzte Änderung" verstellt. Ein Grundsatz des Incident Response lautet daher: „Eingeschaltete Geräte bleiben eingeschaltet und ausgeschaltete Geräte bleiben ausgeschaltet!"

Um eine möglicherweise noch bestehende und missbräuchlich genutzte Kommunikationsverbindung in das lokale Netzwerk oder zu externen Zielen (Internet, DFÜ- und Remote-Access-Zugänge und so weiter) zu unterbinden, sollte maximal die Kommunikationsleitung zum Endgerät selbst getrennt werden (LAN- oder Telefon-Kabel). Sofern eine konkrete Attacke zu diesem Zeitpunkt noch andauert, ist die Dokumentation des Verbindungsstatus zum Beispiel bei einer Wählverbindung vor dem Trennen der Verbindung natürlich sehr wichtig. Oft sind auf dem System entsprechende Monitorprogramme aktiv, die auf einfachste Weise zum Beispiel die Nutzung der ISDN-Kanäle durch eine ISDN-Karte anzeigen (Beispiel ISDN-Watch der AVM Fritz!-Karte). Die hier gezeigte Rufnummer sollte am besten durch Zeugen und durch Abfotografieren des Bildschirms mit einer Digital-Kamera dokumentiert werden. Das Erzeugen eines Bildschirm-Screenshots mit den üblichen Mitteln sollte unterbleiben, da hierdurch bereits wieder auf dem zu untersuchenden System Daten erzeugt werden, die die spätere Analyse möglicherweise beeinträchtigen. Überhaupt muss gerade in der ersten Phase des Incident Response darauf geachtet werden, dass die Änderungen an den Systemen so minimal wie irgend möglich ausfallen bzw. ganz unterbleiben. Dazu gehört auch das äußere Umfeld eines Computers.

Hinzuziehung von Fachleuten

Verdichten sich die Hinweise, dass eine missbräuchliche Benutzung des Computers vorliegt, so sind je nach Sachlage schnellstens die entsprechend zuständigen Fachleute zur Beweissicherung zu verständigen. Sofern der Verdacht auf eine strafrechtlich relevante Konsequenz des Vorfalles vorliegt, so sind unbedingt in einem ersten Schritt die Ermittlungsbehörden einzuschalten. Die Polizei-Präsidien unterhalten zu diesem Zweck entsprechend mit Fachleuten ausgestattete Kommissariate, die die Ermittlung aufnehmen. Grundsätzlich nimmt jede Polizeidienststelle eine entsprechende Anzeige auf und leitet sie weiter. Jedoch ist es auch hier sinnvoll, im Vorfeld ohne eine konkrete Bedrohung bereits mit den lokalen Behörden Kontakt aufzunehmen und die Zuständigkeiten zu erfragen. Diese Kontaktdaten ermöglichen dann im Rahmen des Alarmierungsplanes deutlich schnellere Reaktionszeiten der Ermittler.

Liegt nach Auffassung der mit dem Incident Response beauftragten Mitarbeiter zunächst kein offenkundig strafrechtlich relevanter Hintergrund vor, so kann und sollte die private Beauftragung eines mit der Forensik vertrauten Fachmannes (meist in Form eines EDV-Sachverständigen oder einer auf die Analyse spezialisierten Fachfirma) umgehend erfolgen. Bis zu dessen Eintreffen bleibt die Anlage unter Verschluss. Nicht wenige Gerichtsverfahren sind in der Folge daran gescheitert, dass obwohl es in der Sache selbst stichhaltige Erkenntnisse gegeben hat, die aus Sicht des Technikers für eine Beweisführung vollkommen ausreichend gewesen wären, diese in einem Verfahren nicht gewertet wurden, weil zu viele Personen Zugang zu den Beweisstücken und damit ebenfalls eine Manipulationsmöglichkeit hatten.

Anmerkung: Das ist der Grund, warum Falk Hoffmann in Kapitel 17 so verärgert reagierte. Die Firma Comtec hatte die PC's Calchi und Bertolli eigenständig untersucht und dadurch bereits die Beweisfähigkeit der Spuren geschwächt. Beinahe hätten sie dabei sogar verwertbare Daten gelöscht.